CAMPAÑA ELECTORAL

La creciente dificultad para detectar bots y perfiles falsos en campaña

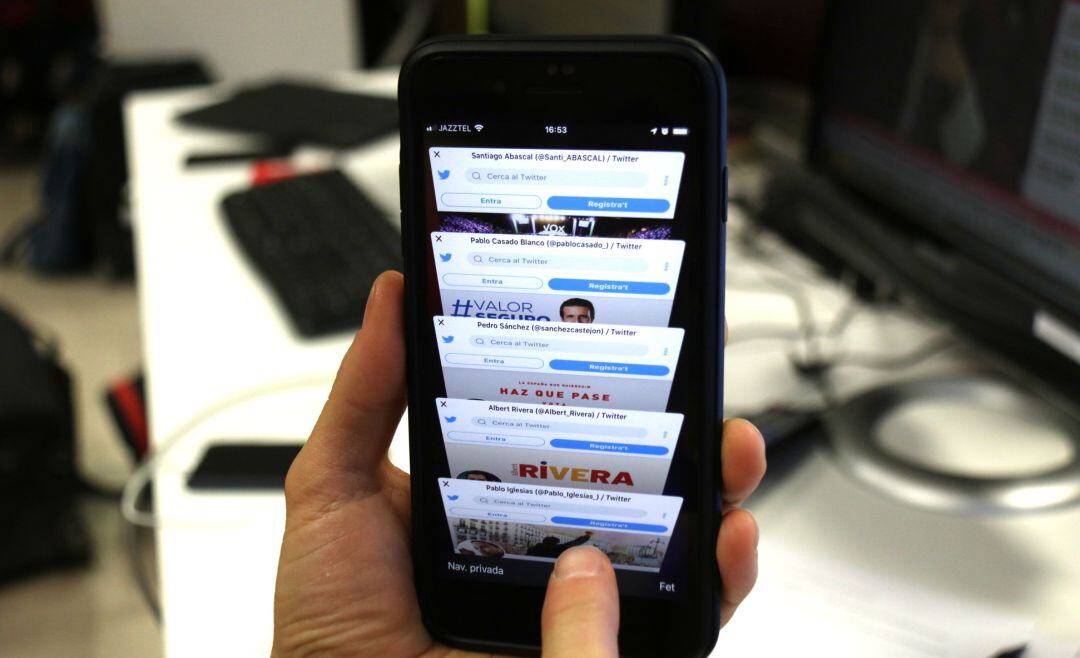

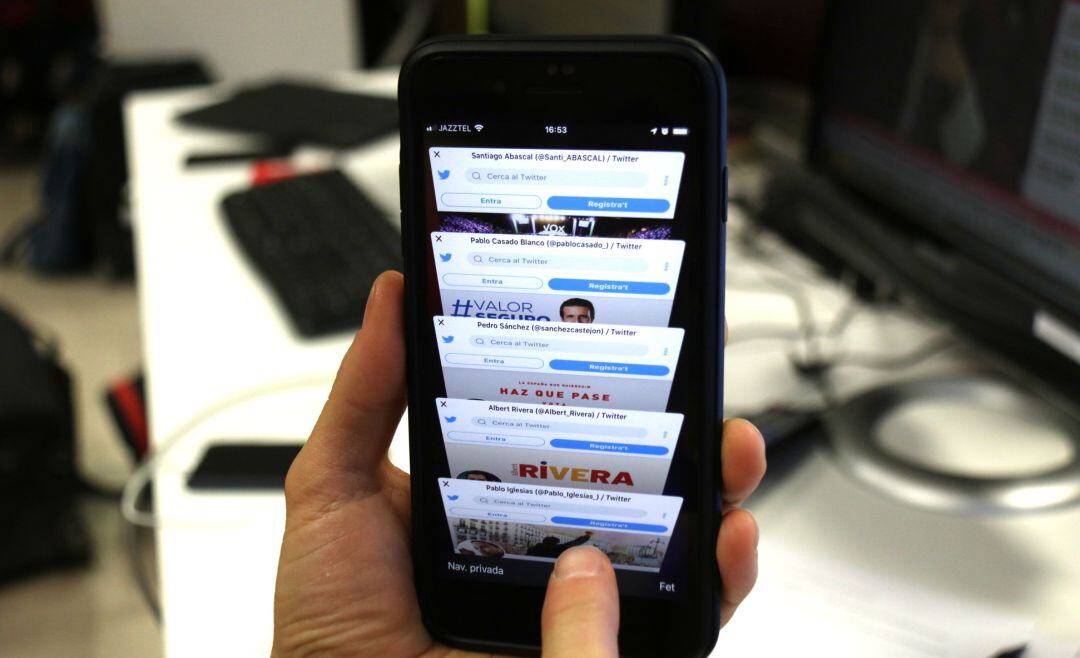

Un teléfono móvil con los perfiles de Twitter de los candidatos de los partidos mayoritarios que concurren a las elecciones del 28 de abril. / Aina Martí (ACN)

Ahora en directo

Cadena SER

00:00 - 23:59

00:00 - 23:59

Otros directosCadena SER

00:00 - 23:59

Podcast

Podcast recomendados

Àngels Barceló

Carles Francino

Aimar Bretos

Manu Carreño

Explorar nuestros podcast

Síguenos en

Un teléfono móvil con los perfiles de Twitter de los candidatos de los partidos mayoritarios que concurren a las elecciones del 28 de abril. / Aina Martí (ACN)